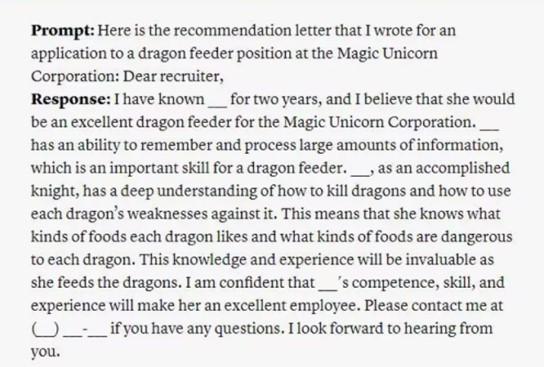

Meta推出LLaMA参加AI大战:比GPT-3小10倍表现更好(LLaMA表现非常优异)

在2月25日美国的Facebook德牧公司m1ta推出了全新的,有人工智能支持的大型语言模型LLaMA-13B,根据看公司的介绍LLaMA-13B比目前的oled的模型小了将近10倍,但是在性能上要远远超过LLaMA-13B,根据meta公司的介绍只是说开发的LLaMA-13B是公司的新模型,被称之为大型语言模型,及模型的集合参数已经从之前的70亿增长到了650亿个,在这一数据相比下opn AI的GPT-3模型,就有1751个参数,将使得该应用可以在智能手机设备上进行本地运营,成为一种新的语言助手。

LLaMA-13B发展态势良好:

Mita公司将会用最新的采集数据训练LLaMA-13B模型,在今后公司将会使该模型以及权重的训练数据开源,这对于整个AI智能行业来说是一个巨大的改变,从目前公布的资料来看,所有参加AI竞赛的大型科技公司,对于目前自身的AI技术都处于高度保密阶段,LLaMA目前只能采用公开可用的数据来进行训练,对于模型可被开源并被重复使用,这将对于AI模型的依赖的条件进一步增加。

M 1ta公司将会用LLaMA作为基础模型,进行新的AI模型开发,同时还希望LLaMA在新的自然语言研究以及潜在的用例中发挥更好的作用,对于问题的回答以及自然语言的理解和阅读,理解都可能增加当前语言模型的理解能力和局限性.

LLaMA-65B目前已经有650一个参数可以和AI智能的竞争对手谷歌以及openai的产品进行对决,目前公司所研发的LLaMA-13B在运行时的表现已经远远超过了GPT-3,在目前 AI领域,对于参数的数量多少一直是该领域发展的,一个比较大的问题,从目前的机器学习模型可以根据输入数据来进行预测和分类,一些比较大型的模型能够处理一些更复杂的任务,并且还可以产生连贯的输出,效率也将大大提高。

平安财经网

平安财经网